Cultura e scienza / Opinioni

Dopo il Covid-19 le Big Tech guardano alla salute mentale

Si diffondono le app dedicate al benessere psichico, ma con forti dubbi su efficacia e privacy. Non c’è da stare tranquilli. La rubrica di Nicoletta Dentico

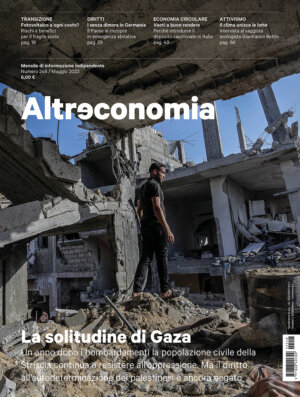

Uno degli effetti indesiderati di Covid-19 è il suo riverbero inatteso, il solco profondo sulla salute mentale. Secondo l’Organizzazione mondiale della sanità (Oms) la pandemia ha fatto svettare ansia e depressione del 25%, soprattutto tra la popolazione più giovane (ma non solo). Nel mondo, il suicidio è la quarta causa di morte nella fascia d’età che va dai 15 ai 19 anni. Long Covid, lo abbiamo definito: l’onda protratta e inafferrabile di un trauma che ci accompagnerà ancora per diverso tempo.

Chi invece ha capito bene l’andazzo, e si è organizzato alla bisogna è Big Tech. Con la pandemia, i giganti dell’industria digitale hanno sperimentato l’occasione imprenditoriale di una vita, una vera svolta sotto il profilo di mercato e finanziario. Hanno assicurato il funzionamento della società globale, riorganizzandola. Superpotenze come Apple, Microsoft, Meta e Amazon son svettate anch’esse del 25%, con profitti fino a 1,2 milioni di miliardi tra 2020 e 2021. In particolare, Covid-19 ha fissato un punto di non ritorno nell’integrazione fra salute e industria digitale.

Nel 2020, gli investimenti in questo settore sono cresciuti del 72% rispetto al 2018 solo negli Stati Uniti, mentre le proiezioni per l’intelligenza artificiale applicata alla salute sono di 300 miliardi di dollari entro il 2030. L’intelligenza artificiale emotiva (emotion Ai), detta anche computing affettivo, è un settore di punta. Esistono più di 20mila app dell’industria del wellness, si prevedono 37 miliardi di dollari entro il 2026, per uno sviluppo senza limiti. Sarà l’emotion Ai d’ora in poi a prendersi cura del male oscuro dell’umanità -un settore della salute trascurato, affidato perlopiù alla costosa sanità privata- attraverso gli smartphone, indispensabili compagni di vita ormai. Le espressioni del viso, il tono della voce, il passo, i battiti del cuore e della ciglia parlano di noi e sono fonti inesauribili di dati, oltre che di profitti.

2,08% è la percentuale di efficacia (supportata da studi clinici) delle app basate sull’intelligenza artificiale emotiva in base a uno studio scientifico realizzato negli Usa nel 2020

Da quando la pandemia ha fatto traslocare la vita umana online, governi e imprese hanno puntato su queste politiche del wellness per affrontare le molteplici dimensioni del long Covid. Ma non mancano i problemi. L’intelligenza artificiale richiede semplificazioni dei modelli psicologici e neurobiologici sulle funzioni delle emozioni e non riesce a catturare la diversità dell’esperienza emotiva umana. Le inflessioni della voce e le gestualità variano da una popolazione all’altra e la necessità di quantificare relazioni qualitative è questione controversa. Inoltre, gli algoritmi riflettono in genere i valori culturali di coloro che li programmano, con il rischio di riprodurre pregiudizi (bias) di tipo etnico, religioso, antropologico: negli Usa, alcuni studi hanno già documentato forme di discriminazioni algoritmiche nei confronti dei neri. Ma se Big Tech si adopera per popolarizzare le applicazioni di monitoraggio autogestito -simili alla conta dei passi, ma applicate alla salute mentale- queste tecnologie spopolano, colonizzando una massa crescente di persone senza controllo clinico. Prive di qualsiasi verifica umana sulla validità ed efficacia del loro funzionamento. Chi ha poi diritto al possesso dei dati emotivi delle persone? Quali sono le violazioni della privacy? Siamo in un campo senza regole.

Così non stupisca che i dati online sulla depressione raccolti dai programmi aziendali di wellness finiscano per costare ai dipendenti il posto di lavoro o un incremento del premium assicurativo. Negli Stati Uniti, BetterHelp e TalkSpace, due app collegate a terapisti aziendali, rivelavano a parti terze informazioni sensibili sulla storia della salute mentale, l’orientamento sessuale, i pensieri suicidi dei lavoratori. Non c’è da star tranquilli.

Nicoletta Dentico è giornalista ed esperta di diritto alla salute. Già direttrice di Medici Senza Frontiere, dirige il programma di salute globale di Society for International Development.

© riproduzione riservata